En 2026, l'arbitrage de trafic a définitivement cessé d'être un jeu de « vitesse ». La modération automatique sur Meta, TikTok et Google repose désormais sur l'apprentissage automatique, l'analyse de graphes et les signaux comportementaux. Pourtant, dans certaines conditions, la décision n'est pas prise par un algorithme, mais par un humain. Et c'est précisément ce manual review qui devient le plus souvent le point de non-retour pour un compte publicitaire.

Dans cet article, nous allons analyser quand s'active la vérification manuelle, ce que regarde exactement le modérateur, où l'infrastructure fait défaut et quel rôle joue Cloaking.House pour réduire les risques.

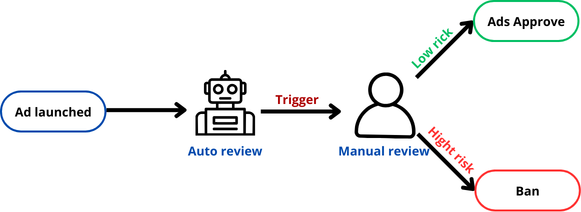

Quand la modération automatique confie le compte à un humain

Les algorithmes laissent passer la majorité des annonces sans intervention humaine. Cependant, il existe une série de déclencheurs (triggers) qui poussent le système à augmenter le niveau de vérification. Cela peut être un CTR anormalement élevé dès les premières heures du lancement, une augmentation brutale du budget, des refus d'annonces répétés, des plaintes d'utilisateurs ou une incohérence entre le GEO publicitaire et les paramètres techniques de l'infrastructure.

Le manual review n'est pas un hasard. C'est une réaction du système à un risque accru. Si le lancement est initialement construit avec des éléments « faibles », la vérification manuelle garantit presque systématiquement des sanctions.

Ce qui se passe pendant l'examen manuel

Contrairement à l'algorithme, le modérateur réfléchit par contexte. Il ne se contente pas d'analyser le texte : il évalue la cohérence de toute la chaîne : l'annonce, la transition, la page, le domaine, le comportement de la redirection et la correspondance avec la région.

Le processus ressemble généralement à ceci :

Clic sur l'annonce depuis le système interne.

Vérification de la redirection (y a-t-il une redirection instantanée ?).

Analyse de la white page.

Examen de la structure du site.

Vérification de l'historique du domaine.

Comparaison du GEO, de la langue et de la devise.

C'est ici que le cloaking commence à jouer un rôle stratégique. Si le flux dans Cloaking.House est correctement configuré, le vérificateur voit une white page complète sans offre agressive. Si la filtration est mal construite, l'humain peut tomber sur la page de l'offre (offer page), et le blocage est alors quasi instantané.

Ce à quoi le modérateur prête attention en priorité

La vérification manuelle ne consiste pas à chercher des mots « gris ». C'est une recherche d'incohérences.

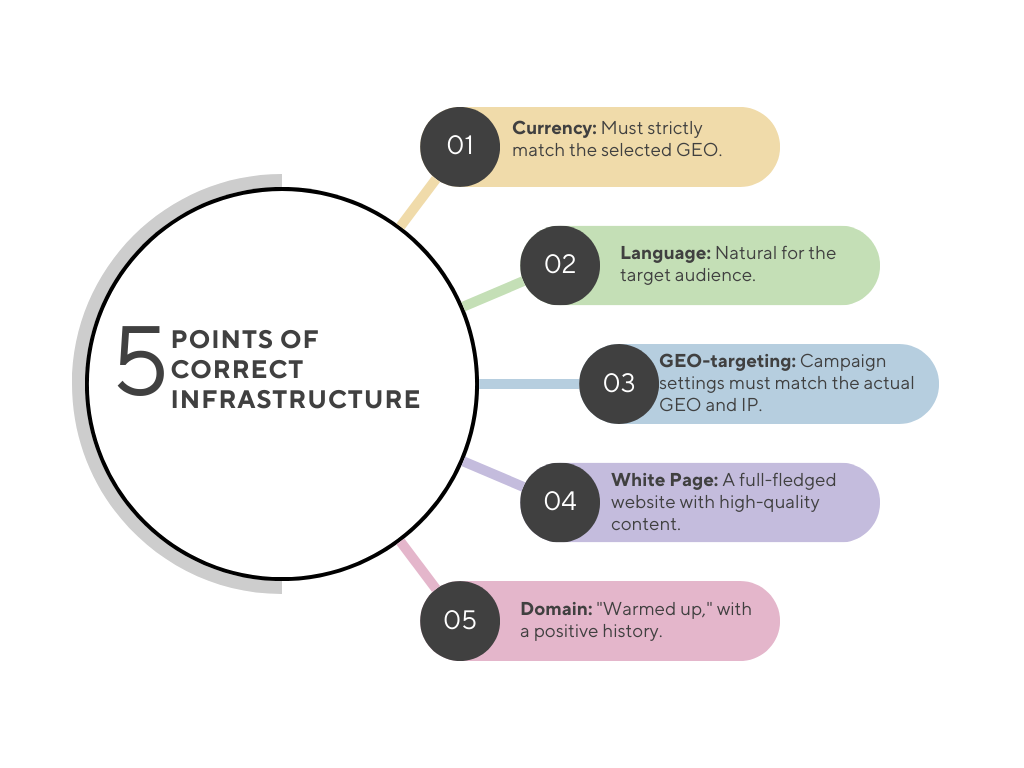

Le modérateur vérifie si la langue de la page correspond au GEO ciblé, si la devise s'affiche correctement, si le format de la date correspond à la région et si l'adresse semble réaliste. Si la publicité est lancée en Allemagne mais que la page contient un format de téléphone américain et une devise en dollars, c'est déjà un signal d'alerte.

Ensuite, la structure du site est évaluée. La présence d'un menu, d'un pied de page (footer), d'une politique de confidentialité et de coordonnées crée une impression de projet réel. L'absence de ces éléments renforce les soupçons.

Le contenu est également analysé sous l'angle des affirmations agressives : revenus garantis, promesses médicales, « offre exclusive aujourd'hui seulement ». Même si ces formulations ne violent pas directement les règles, elles peuvent justifier une analyse plus approfondie du compte.

Où surviennent le plus souvent les bannissements

La majorité des blocages lors du manual review ne sont pas liés au créatif, mais à l'infrastructure.

Voici un résumé des points de risque typiques :

| Zone de vérification | Cause du soupçon | Conséquence |

| White page | Structure type, texte minimaliste | Refus de l'annonce |

| GEO | Incohérence de langue et de devise | Blocage du compte |

| Domaine | Nouveau, sans historique | Risque accru |

| Cohérence | Répétition de domaines / cartes / templates | Bannissement massif |

Le rôle du cloaking face à la modération manuelle

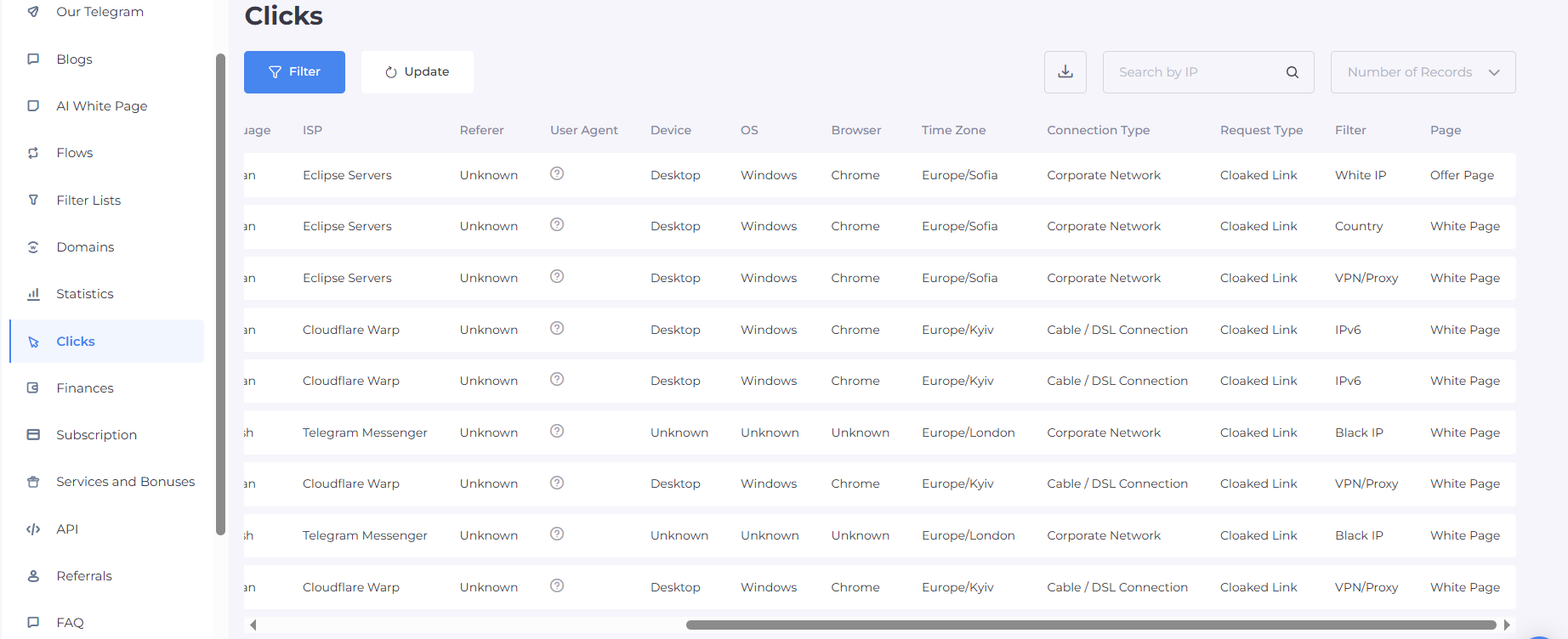

Il est important de comprendre que le cloaking ne sert pas à « tromper » le modérateur. Il structure le flux de trafic et segmente les audiences. Le vérificateur accède à une version correcte et sûre de la page, conforme aux exigences de la plateforme. Le trafic des utilisateurs réels accède à sa version cible.

Cloaking.House permet de configurer la filtration de manière flexible et de gérer les flux de trafic en séparant les modérateurs, les bots et les utilisateurs réels.

Un cloaking de qualité résout trois problèmes :

isolation du trafic de vérification ;

contrôle des signaux comportementaux ;

réduction de la probabilité que l'offre soit analysée directement.

Cependant, le cloaking en lui-même n'est pas une garantie de sécurité. Si la white page semble artificielle ou si le domaine a un historique négatif, la vérification manuelle se terminera tout de même par des sanctions.

Quand le cloaking ne suffit plus

Il existe des situations où même une filtration idéale n'empêche pas le bannissement. Si le compte est déjà dans une zone de risque, si la même infrastructure de paiement est utilisée pour de nombreux lancements ou si le système a détecté une liaison entre les comptes, le manual review devient une simple formalité.

Le risque augmente également lors d'une mise à l'échelle (scaling) brutale du budget. L'humain commence alors à vérifier non seulement la page, mais aussi l'historique de comportement du compte : fréquence des lancements, vitesse de création des annonces, répétitivité des domaines.

Scénario d'un bannissement classique

En pratique, cela se déroule comme suit :

Premier jour : la campagne passe la modération automatique.

Deuxième jour : le CTR augmente.

Troisième jour : le budget augmente. Le système détecte une anomalie.

Quatrième jour : vérification manuelle.

Cinquième jour : blocage du compte pour « contournement des règles ».

Le problème ne vient pas du créatif, mais du fait que l'infrastructure n'était pas synchronisée : domaine neuf, white page générique, langue ne correspondant pas totalement au GEO.

Comment réduire le risque de manual review

La minimisation du risque repose non seulement sur le « masquage », mais sur la cohérence des éléments :

correspondance du GEO dans tous les paramètres ;

white page complète et crédible ;

structure de domaine logique ;

mise à l'échelle progressive du budget ;

filtration correcte du trafic via le cloaking.

Lors du scaling du budget, il est crucial de rester progressif. Une pratique sûre consiste à augmenter le budget de pas plus de 20 % par étape. Les sauts de dépenses brusques sont souvent perçus comme une anomalie par le système et peuvent déclencher une vérification.

Conclusion

La modération manuelle en 2026 n'est pas une exception, mais une partie normale du cycle de vérification des campagnes publicitaires. Les algorithmes identifient le risque, l'humain confirme la décision. Et c'est à ce moment-là qu'il devient évident si l'architecture du lancement a été bien pensée.

Le cloaking dans ce modèle n'est pas un moyen de « cacher » l'offre, mais un outil de gestion des flux et de réduction des risques infrastructurels. Avec un réglage approprié, Cloaking.House isole le trafic de vérification et aide à passer le manual review sans blocages.

Si l'on regarde le processus avec les yeux du modérateur, une chose est claire : le bannissement est presque toujours la conséquence d'une incohérence. Une architecture de lancement systémique est le seul moyen de minimiser les risques à long terme.

Soyez le premier à partager votre avis !

Nous apprécions vos retours — partagez votre avis.