Tout spécialiste de l'arbitrage ou du marketing travaillant avec des offres grises ou complexes finit tôt ou tard par se heurter au principal ennemi du profit : les bots de modération. Facebook, Google, TikTok et d'autres géants de la publicité dépensent des millions de dollars pour développer des algorithmes intelligents. Les bots scannent vos pages cibles 24h/24 à la recherche de la moindre infraction. Le résultat de leur travail est toujours le même, et il n'est que trop familier à tout webmaster.

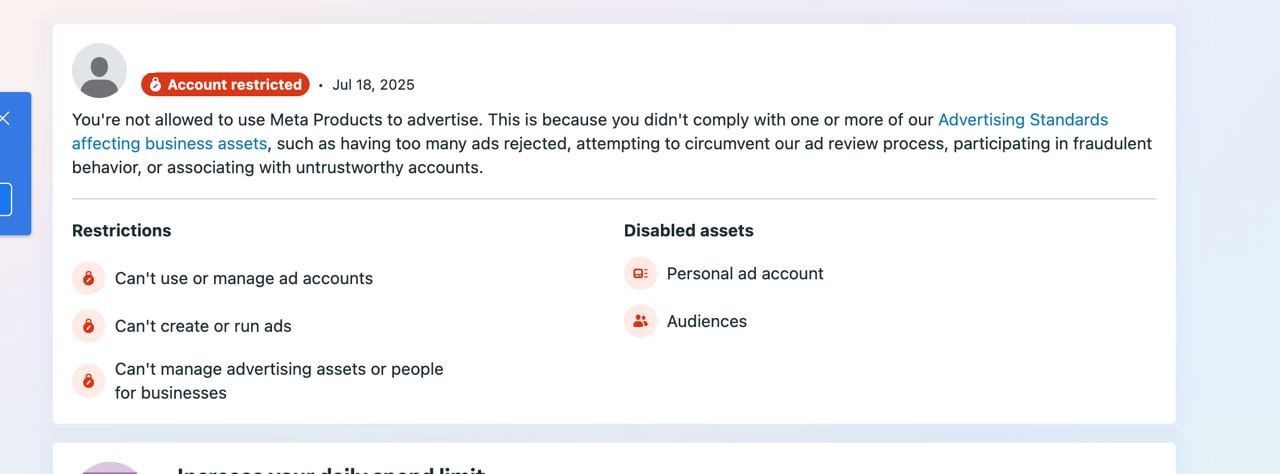

Ce bandeau rouge dans l'Ads Manager n'est pas qu'une simple notification technique. C'est le symbole d'un budget gaspillé, du temps passé à farmer des comptes et, ce qui est le plus frustrant, d'un profit perdu. On a l'impression d'avoir tout bien fait, mais l'algorithme s'est montré plus rusé.Mais ces algorithmes sont-ils vraiment infaillibles ? Comment fonctionnent-ils exactement, quelles traces laissent-ils dans vos analyses, et surtout — comment s'assurer techniquement qu'ils ne voient que ce qu'ils sont censés voir ? Voyons cela de plus près.

Pourquoi les bots parviennent-ils quand même sur le site ?

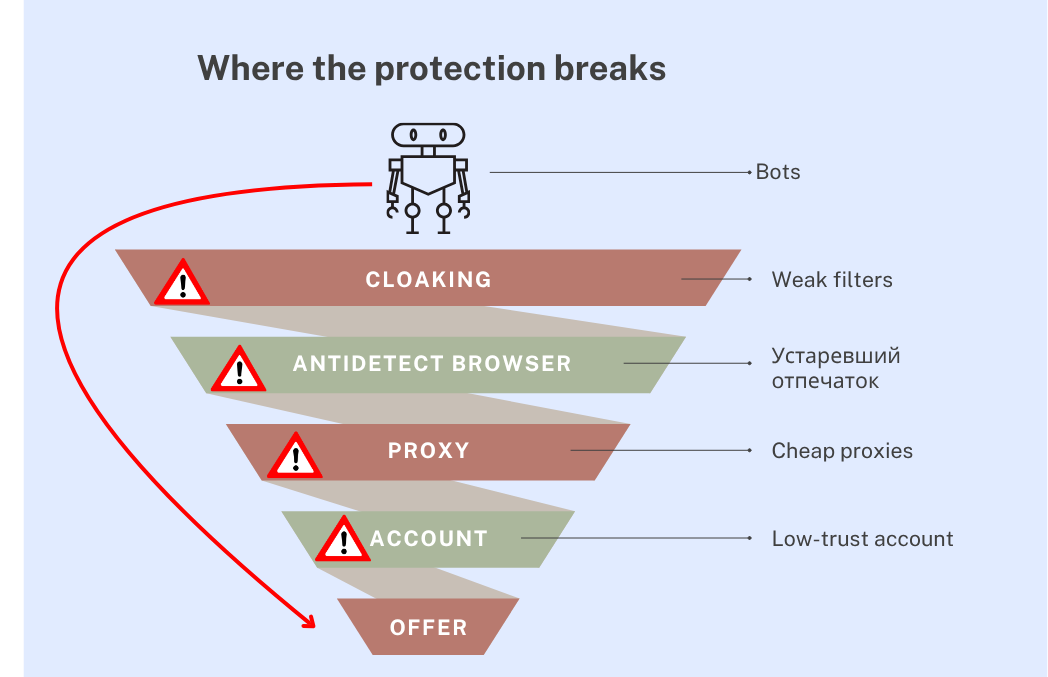

Les réseaux publicitaires n'utilisent plus depuis longtemps des bots primitifs qui frappent à la porte du site avec des adresses IP de centres de données et s'annoncent ouvertement dans le User-Agent. La modération moderne est un réseau neuronal complexe qui analyse un ensemble de facteurs.Lorsque le bot brise votre protection et arrive sur la page cible (offer page) au lieu de la page blanche (white page), il se produit ce qu'on appelle un « maillon rompu ». Pourquoi le système échoue-t-il et laisse-t-il passer les contrôleurs ?

Le plus souvent, le problème réside dans la préparation technique du tunnel lui-même :

Filtres de cloaking affaiblis : Dans la course à chaque clic, les webmasters réduisent souvent la sévérité du filtrage, par peur d'exclure de vrais utilisateurs. C'est de cela que profitent les bots intelligents, qui se camouflent en trafic mobile ordinaire. De plus, l'utilisation de scripts de protection gratuits ou obsolètes garantit des fuites — leurs bases de données d'adresses IP de modérateurs sont mises à jour trop rarement.

Proxys bon marché et spammés : Si vous travaillez avec des proxys de serveur, gratuits ou simplement « usés » (IPv4/IPv6), le réseau publicitaire le voit instantanément. L'algorithme vous marque comme une menace avant même le début de la diffusion et lance contre votre lien les bots les plus agressifs et avancés, qu'un cloaking faible laissera passer.

Travail sans navigateur anti-détection (ou mauvaise configuration) : Si vous n'utilisez pas un navigateur anti-détection de qualité, votre empreinte numérique (matériel, Canvas, WebGL, polices) vous trahit totalement. Facebook ou Google voient que des dizaines de campagnes sont lancées depuis un seul appareil. Le résultat est le même — une inspection totale de tous vos liens par l'artillerie lourde des bots de modération.

Compte à faible Trust : Les comptes récents (auto-regs) sans farm, sans historique d'achat et sans interaction sociale sont sous le microscope du système. Les plateformes publicitaires n'ont pas confiance (« trust ») en ces comptes, c'est pourquoi tout lien y est examiné minutieusement, avec imitation de clics et passage par tous les redirects.

Domaine douteux : Les zones de domaine bon marché (comme .xyz, .tk, .site) ou les domaines fraîchement enregistrés sans historique sont un signal d'alerte pour la modération. Les annonceurs sérieux utilisent rarement ces zones pour des affaires sérieuses. En voyant un tel domaine, l'algorithme augmente immédiatement le niveau de suspicion et envoie des bots chercher le piège.

Le prix de l'erreur : conséquences de la détection de la page cible

Lorsque le « maillon rompt » et qu'un bot de modération ou un réviseur humain enregistre le contenu réel de votre page de destination, le réseau publicitaire prend immédiatement des mesures punitives. Selon la gravité de l'infraction (la dureté de l'offre) et le trust de votre compte, les conséquences se divisent en plusieurs niveaux de gravité :

Refus des annonces (Ad Rejection) : Le scénario le plus léger, mais désagréable. L'annonce reçoit le statut « Refusé ». Généralement, l'algorithme appose l'étiquette « Contournement des systèmes » (Circumventing Systems) ou indique la promotion de modèles commerciaux inacceptables. Relancer ces publicités sans changer les liens mène rapidement au ban de tout le compte publicitaire.

Déclenchement de contrôles de sécurité (Checkpoints) : La plateforme suspend la diffusion et gèle le compte, soupçonnant une activité atypique. Le système exige de confirmer l'identité : télécharger une photo d'identité (ID), passer un contrôle par selfie ou enregistrer une vidéo. Lors du travail avec des comptes achetés, passer un tel checkpoint devient souvent impossible, et le compte finit à la poubelle.

Blocage au niveau de l'Ads Manager ou du Business Manager : Un ban définitif sans possibilité d'appel (ou avec des chances minimes via le support technique). Le système désactive complètement la possibilité de publier des publicités, gelant toutes les campagnes actives et les moyens de paiement associés.

Ban des consommables : Les algorithmes des réseaux publicitaires travaillent de manière globale. Ce n'est pas seulement le compte publicitaire qui tombe, mais aussi les consommables associés. Le domaine est marqué comme malveillant et devient inutilisable pour d'autres comptes, et la Fan Page perd le droit de publier du contenu.

Anatomie du bot : Comment les reconnaître dans les statistiques de Cloaking.House

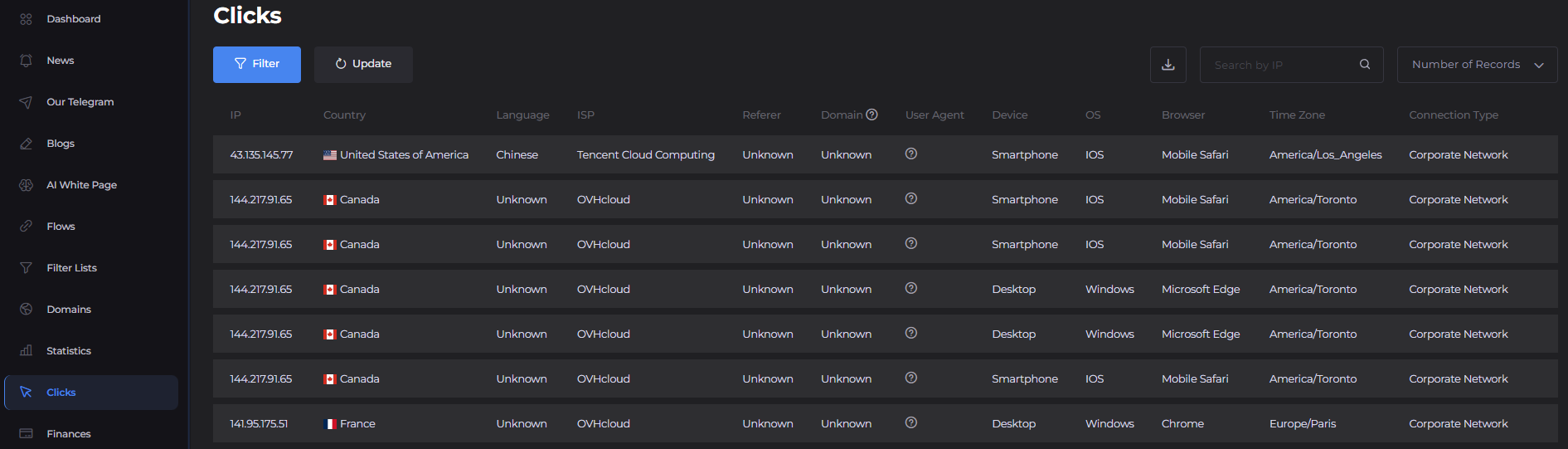

Même les algorithmes de modération les plus avancés commettent des erreurs techniques impossibles à cacher lors d'une analyse détaillée. Le principal avantage de Cloaking.House n'est pas seulement son filtrage puissant, mais aussi la statistique transparente pour chaque clic. Vous n'avez pas à deviner pourquoi le système a rejeté une transition. En ouvrant les clics, vous verrez les informations complètes du visiteur.

Analysons les « drapeaux rouges » typiques à partir d'un rapport de clics standard de votre espace personnel :

Clics multiples depuis une seule IP : Si vous voyez une rafale de requêtes provenant de la même adresse IP (comme dans l'exemple 144.217.91.65) sur un intervalle de temps très court — c'est un signe clair de scan automatisé. Un utilisateur réel ne rafraîchit pas la page 10 fois de suite.

Comportement étrange des appareils et navigateurs : C'est le facteur le plus évident des modérateurs. Notez ceci : un bot, depuis la même adresse IP, parvient à changer son « matériel » en une fraction de seconde. Il fait un clic depuis un smartphone sous iOS via Mobile Safari, et le suivant déjà depuis un bureau sous Windows via Microsoft Edge. Dans la vie réelle, un utilisateur ne peut pas physiquement changer d'appareil aussi vite en restant sur la même IP.

Fournisseurs de centres de données (ISP) : Les vrais prospects utilisent l'internet mobile ou résidentiel (Verizon, Vodafone, etc.). Les bots, en revanche, ne s'embêtent souvent pas avec des proxys résidentiels et viennent directement des serveurs d'hébergeurs connus. Si vous voyez dans la colonne ISP des noms comme OVHcloud, Tencent Cloud, DigitalOcean ou Amazon, et que le type de connexion est identifié comme « Centre de données » (Data Center).

En-têtes vides et absence de traces (Unknown) : Le bot-checker manque souvent des paramètres de base d'un utilisateur réel car le script ne les transmet tout simplement pas. Pas de langue de navigateur (Unknown), pas de référant (source de la transition), pas de domaine déterminé. Le trafic réel provenant de Facebook, Google ou TikTok transmet toujours le référant de la plateforme. Si tout est « Unknown » — vous êtes face à une machine sans âme.

Comportement anormal sur la page : En plus des données techniques, les bots se trahissent par leurs actions. Ils peuvent cliquer sur des éléments non cliquables, ouvrir instantanément tous les liens disponibles dans de nouveaux onglets (pour indexer le site plus vite) ou scroller la page de manière parfaitement uniforme, en y restant exactement 0,1 seconde.

Comment fermer définitivement l'accès aux bots ?

Analyser les clics et identifier les bots manuellement est un travail de Sisyphe. Le temps que vous collectiez les adresses IP et les ajoutiez à la liste noire, le réseau publicitaire aura déjà banni votre compte. Pour éviter les intrusions de bots, le filtrage doit se produire avant que le visiteur ne charge la pagina.

C'est précisément pour cela qu'a été créé Cloaking.House — un outil professionnel pour la protection de votre trafic et le filtrage des visiteurs indésirables.

Pourquoi Cloaking.House résout ce problème :

Machine Learning et bases actualisées : Le système ne se contente pas de vérifier les adresses IP. Il analyse des dizaines de paramètres (User-Agent, en-têtes, résolution d'écran, empreintes de navigateur) en temps réel, bloquant même les bots les plus avancés de Facebook, Google, TikTok et d'autres réseaux.

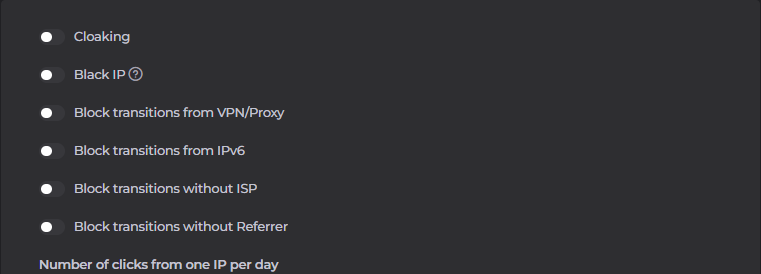

Pas de tunnels découverts : Les algorithmes de filtrage avancés garantissent qu'un bot de modération, un service d'espionnage ou un concurrent ne verra que votre White Page parfaitement propre.

Configuration flexible : C'est vous qui décidez qui laisser passer sur l'Offer Page et qui bloquer. Vous pouvez filtrer le trafic par géo, appareils, fournisseurs, VPN/Proxy et d'autres paramètres.

Intégration simple : La configuration ne prend que quelques minutes et ne nécessite aucune connaissance en programmation.

Pour conclure

Les bots de modération deviennent chaque jour plus intelligents. Ils imitent les clics, ouvrent des onglets et se camouflent en personnes réelles. Se fier à l'analyse manuelle ou à des scripts bon marché, c'est risquer vos budgets publicitaires et vos nerfs.

Sécurisez vos tunnels, confiez le filtrage du trafic à des solutions professionnelles comme Cloaking.House, et faites en sorte que vos comptes vivent longtemps et que votre ROI progresse de façon stable !

Soyez le premier à partager votre avis !

Nous apprécions vos retours — partagez votre avis.