Cloaking, gri dikey alanlarda (gray verticals) çalışırken uzun zamandır temel araçlardan biri olmuştur ve Meta Ads, Google Ads ve Bing Ads dahil olmak üzere hemen hemen tüm popüler reklam ağlarında kullanılmaktadır. Düzenli olarak cloaking ile çalışıyorsanız, muhtemelen moderasyonun Teklif Sayfasını (Offer Page) açığa çıkardığı bir durumla karşılaşmışsınızdır. Böyle anlarda her zaman doğrudan cloaking sistemini suçlamak doğru değildir: Çoğu durumda sebep, yapılandırma hataları, zayıf maskeleme veya gözden kaçan önlemlerdir. Bu nedenle, reklam ağlarının cloaking'i nasıl tespit ettiğini, hangi sinyallerin kurulumu ele verdiğini ve çalışan bir şemanın bile neden hızla deşifre edilebileceğini önceden anlamak önemlidir.

Eğer bu materyali sorunla karşılaşmadan önce açtıysanız, bu daha da iyidir. Bu makalede, reklam yayını sırasında cloaking tespitine yol açan en sık yapılan hataları analiz edecek ve reklam platformları tarafından bir kurulumun açığa çıkarılmasına en sık neden olan faktörleri inceleyeceğiz.

Reklam Ağının Yerleşik Metriklerinin Kullanımı

Reklam platformlarının yerleşik metriklerinin kullanılması, reklam ağlarının cloaking'i tespit etmesine yardımcı olan en yaygın faktörlerden biridir. Birçok affiliate ve medya satın almacı, Teklif Sayfasındaki dönüşümleri, tıklamaları ve kullanıcı davranışlarını daha doğru takip etmek için Facebook Pixel veya Google Analytics gibi araçları bağlar. Ancak tam da bu aşamada ciddi bir güvenlik açığı ortaya çıkar: Moderasyon sistemi ek bir veri kaynağı elde eder ve reklam bağlantısı, kullanıcı yolu ve analitiğin toplandığı gerçek sayfa arasında ilişki kurabilir.

Reklam ağı açısından böyle bir bağlantı şüpheli ve mantıksız görünür: Reklam ve Beyaz Sayfa (White Page) resmi olarak tek bir giriş noktasını gösterirken, etkinlikler, pikseller ve analitik sinyalleri başka bir sayfada kaydedilir. Beyan edilen hedef ile gerçek veri toplama yeri arasındaki bu tutarsızlık, otomatik doğrulama sistemleri ve manuel moderasyon için belirgin bir işaret haline gelir. Bu nedenle, doğrudan reklam platformuna bağlı metriklerin kullanımı, genellikle Teklif Sayfasının ve tüm cloaking şemasının açığa çıkmasını hızlandıran faktörlerden biri olarak kabul edilir.

Reklam ağı açısından böyle bir bağlantı şüpheli ve mantıksız görünür: Reklam ve Beyaz Sayfa (White Page) resmi olarak tek bir giriş noktasını gösterirken, etkinlikler, pikseller ve analitik sinyalleri başka bir sayfada kaydedilir. Beyan edilen hedef ile gerçek veri toplama yeri arasındaki bu tutarsızlık, otomatik doğrulama sistemleri ve manuel moderasyon için belirgin bir işaret haline gelir. Bu nedenle, doğrudan reklam platformuna bağlı metriklerin kullanımı, genellikle Teklif Sayfasının ve tüm cloaking şemasının açığa çıkmasını hızlandıran faktörlerden biri olarak kabul edilir.

Teklif Teması ile Beyaz Sayfa İçeriği Arasındaki Belirgin Farklar

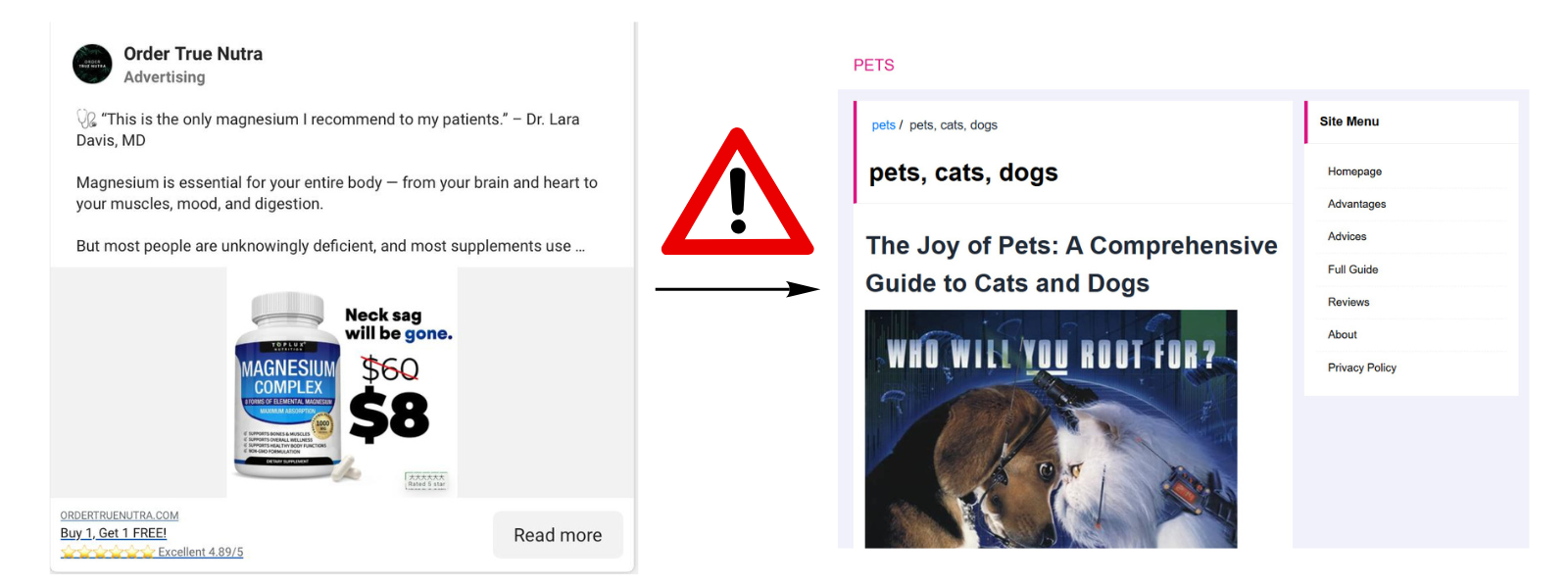

Reklam ağlarının cloaking'i tespit etmesinin sık karşılaşılan bir nedeni, Teklif Sayfası, reklam ve Beyaz Sayfa arasındaki bariz tematik uyumsuzluktur. Reklam görseli ve teklif açıkça kilo verme, gıda takviyeleri veya başka bir spesifik ürün kategorisinden bahsederken, Beyaz Sayfa tamamen farklı bir konuya ayrılmışsa, bu boşluk moderasyon için hızla bariz bir sinyale dönüşür. Sayfayı mümkün olduğunca "güvenli" hale getirme isteği genellikle ters etki yaratır: Reklam sistemi doğal bir mantık yerine yapay bir anlam değişikliği görür ve genellikle bu tutarsızlıklar ek bir inceleme için tetikleyici olur.

Reklam ağlarının cloaking'i tespit etmesinin sık karşılaşılan bir nedeni, Teklif Sayfası, reklam ve Beyaz Sayfa arasındaki bariz tematik uyumsuzluktur. Reklam görseli ve teklif açıkça kilo verme, gıda takviyeleri veya başka bir spesifik ürün kategorisinden bahsederken, Beyaz Sayfa tamamen farklı bir konuya ayrılmışsa, bu boşluk moderasyon için hızla bariz bir sinyale dönüşür. Sayfayı mümkün olduğunca "güvenli" hale getirme isteği genellikle ters etki yaratır: Reklam sistemi doğal bir mantık yerine yapay bir anlam değişikliği görür ve genellikle bu tutarsızlıklar ek bir inceleme için tetikleyici olur.

Reklam platformları için sadece sayfanın resmi temizliği değil, aynı zamanda kullanıcı yolculuğunun genel mantığı da önemlidir. Reklam bir şey vaat ederken, alan adı ve geçiş bir yöne gidiyor gibi görünüp Beyaz Sayfanın içeriği genel temadan kopuyorsa, bu teklifin gerçek özünü gizleme girişimi olarak görünür. Bu nedenle, reklam, Teklif Sayfası ve açılış sayfası arasındaki anlamsal boşluk, sistemin manipülasyondan şüphelenip cloaking'i açığa çıkarabileceği en dikkat çekici işaretlerden biri olarak kabul edilir.

Beyaz Sayfaya Doğrudan Yönlendirme (Redirect) Kullanımı

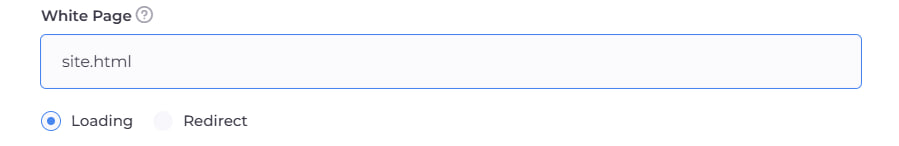

Cloaking House, bir Beyaz Sayfayı görüntülemek için iki yöntem kullanır ve bunların her biri reklam ağlarının kullanıcı geçişini analiz etme şeklini farklı etkiler. Yükleme (Loading), sayfa içeriğinin doğrudan hostingden yüklenmesini içerirken, yönlendirme (Redirect), şüpheli trafiğin ayrı bir URL'ye yönlendirilmesini içerir. İlk durumda kullanıcı ve moderasyon aynı adres içinde kalırken, ikincisinde zincirde ek bir geçiş ortaya çıkar ve bu geçişin kendisi doğrulama için ayrı bir nesne haline gelir.

Konu bağlamında bu özellikle önemlidir; çünkü rotadaki her türlü gereksiz değişiklik, URL'lerdeki farklılıklar ve geçiş mantığındaki tutarsızlıklar, reklam platformu moderasyonunun şüphelerini artırabilir. Reklamdan nihai sayfaya giden yol ne kadar karmaşık görünürse, platformun adresleri, yönlendirmeleri ve gerçek içeriği daha yakından inceleme olasılığı o kadar artar. Bu nedenle, bu tür bağlantıları analiz ederken sadece Beyaz Sayfayı değil, aynı zamanda görüntülenme yöntemini de dikkate almak önemlidir, çünkü bu da reklam ağının tutarsızlıkları belirleyebileceği sinyaller oluşturur.

Konu bağlamında bu özellikle önemlidir; çünkü rotadaki her türlü gereksiz değişiklik, URL'lerdeki farklılıklar ve geçiş mantığındaki tutarsızlıklar, reklam platformu moderasyonunun şüphelerini artırabilir. Reklamdan nihai sayfaya giden yol ne kadar karmaşık görünürse, platformun adresleri, yönlendirmeleri ve gerçek içeriği daha yakından inceleme olasılığı o kadar artar. Bu nedenle, bu tür bağlantıları analiz ederken sadece Beyaz Sayfayı değil, aynı zamanda görüntülenme yöntemini de dikkate almak önemlidir, çünkü bu da reklam ağının tutarsızlıkları belirleyebileceği sinyaller oluşturur.

Zayıf Filtreleme Ayarları

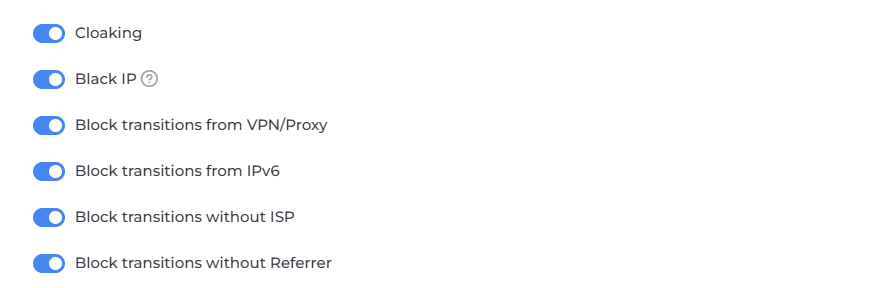

Reklam ağlarının cloaking'i tespit etmesinin en bariz nedeni, zayıf veya tutarsız trafik filtreleme ayarları olmaya devam etmektedir.

Basitçe söylemek gerekirse, Cloaking House sistemlerindeki filtreleme, trafik yolu üzerindeki bir dizi kontrol noktası gibi çalışır. Her biri belirli bir sinyal tipinden sorumludur ve kaynak, teknik parametreler veya geçişin doğası açısından şüpheli görünen ziyaretleri filtrelemeye yardımcı olur. Bu seviyelerden biri zayıf, eksik veya istikrarsız çalıştığında, reklam ağı kullanıcı rotasında tutarsızlıklar görmeye başlar. Ve bu tür tutarsızlıklar zaten ek bir inceleme için ciddi bir nedendir ve lansman sırasında cloaking'in deşifre edilmesindeki temel faktörlerden biridir.

Birincil filtrelemenin temel seviyeleri özellikle önemlidir, çünkü anormal ziyaretlere ve standart dışı teknik sinyallere ilk tepki veren onlardır. Sistem mantığına bağlı olarak farklı işaretler analiz edilebilir:

Cloaking Filtresi — Herhangi bir reklam kanalından gelen botları ve doğrulama trafiğini kesmek için tasarlanmış temel bir koruma mekanizmasıdır. Etkinleştirildiğinde, şüpheli ziyaretler otomatik olarak Beyaz Sayfaya yönlendirilir.

Cloaking Filtresi — Herhangi bir reklam kanalından gelen botları ve doğrulama trafiğini kesmek için tasarlanmış temel bir koruma mekanizmasıdır. Etkinleştirildiğinde, şüpheli ziyaretler otomatik olarak Beyaz Sayfaya yönlendirilir.

Black IP Filtresi — Sistem daha önce belirli bir IP adresinden istenmeyen bir aktivite kaydettiyse açılır. Bu; botların, moderatörlerin tespiti, ülke veya sağlayıcının belirlenememesi ve tanımlanamayan cihazlardan yapılan geçiş denemeleri sırasında oluşabilir. Tetiklenirse kullanıcı Beyaz Sayfaya yönlendirilir.

VPN / Proxy Filtresi — Bir ziyaretçinin IP adresi bir proxy sunucusuna veya VPN'e ait olarak tanındığında tepki verir. Sadece akış parametrelerinde açıkça etkinleştirildiğinde çalışır. Etkinleştirildiğinde trafik Beyaz Sayfaya gider.

IPv6 Filtresi — Sistemin ziyaretin bir IPv6 adresinden yapıldığını belirlemesi durumunda uygulanır. Filtrenin tetiklenmesi Beyaz Sayfanın görüntülenmesine yol açar.

ISP Filtresi — Kullanıcının internet servis sağlayıcısının IP adresi üzerinden tespit edilemediği durumlarda kullanılır. Filtre etkinleştirildiğinde Beyaz Sayfa görüntülenir.

Yönlendiren (Referrer) Filtresi — Tarayıcı adres çubuğuna doğrudan bağlantı girişi durumları da dahil olmak üzere, geçiş kaynağı (Referer) eksikse veya belirlenemiyorsa etkinleşir. Tetiklendiğinde ziyaretçi Beyaz Sayfaya yönlendirilir.

Düşük Kaliteli Beyaz Sayfa

Cloaking mükemmel teknik yapılandırma gerektirir, ancak sistemin kaçınılmaz olarak değişikliği açığa çıkardığı en yaygın ve ölümcül hata, düşük kaliteli bir Beyaz Sayfadır. Google Ads ve Facebook gibi reklam ağları, yapay zeka algoritmalarını sürekli geliştirmektedir. Eğer "beyaz" siteniz alelacele bir araya getirilmiş bir yer tutucu gibi görünüyorsa, hesap engellemesi sadece an meselesidir.

Affiliate'i moderatörlere ele veren temel tetikleyicileri inceleyelim ve mükemmel bir beyaz sayfanın nasıl oluşturulacağını anlayalım.

1. Sitenin Görsel ve İşlevsel Yetersizliği

Sayfanız insanlar için oluşturulmuş gerçek, canlı ve işlevsel bir web kaynağı gibi görünmelidir. Her türlü sahtelik hissi, değerlendiriciler ve botlar tarafından anında kaydedilir.

Tam Yapı: Sitenin sadece ana sayfası değil, aynı zamanda "Hakkımızda", "İletişim", "Gizlilik Politikası" ve kullanıcı sözleşmesi bölümleri de olmalıdır.

Yükleme Hızı: Beyaz Sayfa anında ve gecikme olmadan açılmalıdır. Yavaş yükleme, Google için ilk kırmızı bayraktır. Hafif şablonlar kullanın, görselleri optimize edin ve güvenilir bir hosting seçin.

Duyarlılık (Responsiveness): Site her türlü cihazda, özellikle de cep telefonlarında doğru şekilde görüntülenmelidir.

Önemli Kural: Bir moderatör veya bot, kullanıcıya değer sunan gerçek bir işletme veya bilgi portalına baktığına inanmalıdır.

2. Diğer Sitelerin Körü Körüne Kopyalanması

Yeni başlayanlar arasında, Beyaz Sayfa olarak kullanmak üzere halihazırda mevcut güvenilir siteleri indirme ve kopyalama pratiği popülerdir. Bu büyük bir hatadır.

Google algoritmaları, içerik ve yapının benzersizliği konusunda özellikle dikkatlidir. Eğer bir bot, sitenizin web üzerinde zaten dizine eklenmiş bir kaynağın tam bir kopyası olduğunu görürse, onu hemen kimlik avı veya spam olarak işaretleyecektir. Bir beyaz sayfa oluşturmak için benzersiz içerik oluşturucular, sinir ağları kullanın veya indirilen şablonları tanınmayacak kadar özgünleştirin: meta etiketlerini, kod yapısını, metinleri ve görselleri değiştirin.

3. Alan Adı Hijyeninin İhlali

Reklam hesabı engellemelerinin bir diğer yaygın nedeni, alan adlarıyla yanlış çalışılmasıdır.

Kampanya İzolasyonu: Farklı reklam kampanyaları veya teklifler için asla aynı alan adını kullanmayın.

Toksik Geçmiş: Belirli bir alan adında zaten ban (engelleme) aldıysanız, onu unutun. Reklam ağları bu tür adresleri kara listeye alır. Üzerinde yeni bir kampanya başlatma girişimi, görselleri ve Beyaz Sayfayı değiştirmiş olsanız bile anında zincirleme ban almanıza neden olur.

Alaka Düzeyi: Alan adı, "beyaz" sitenizin temasına mantıksal olarak uymalıdır.

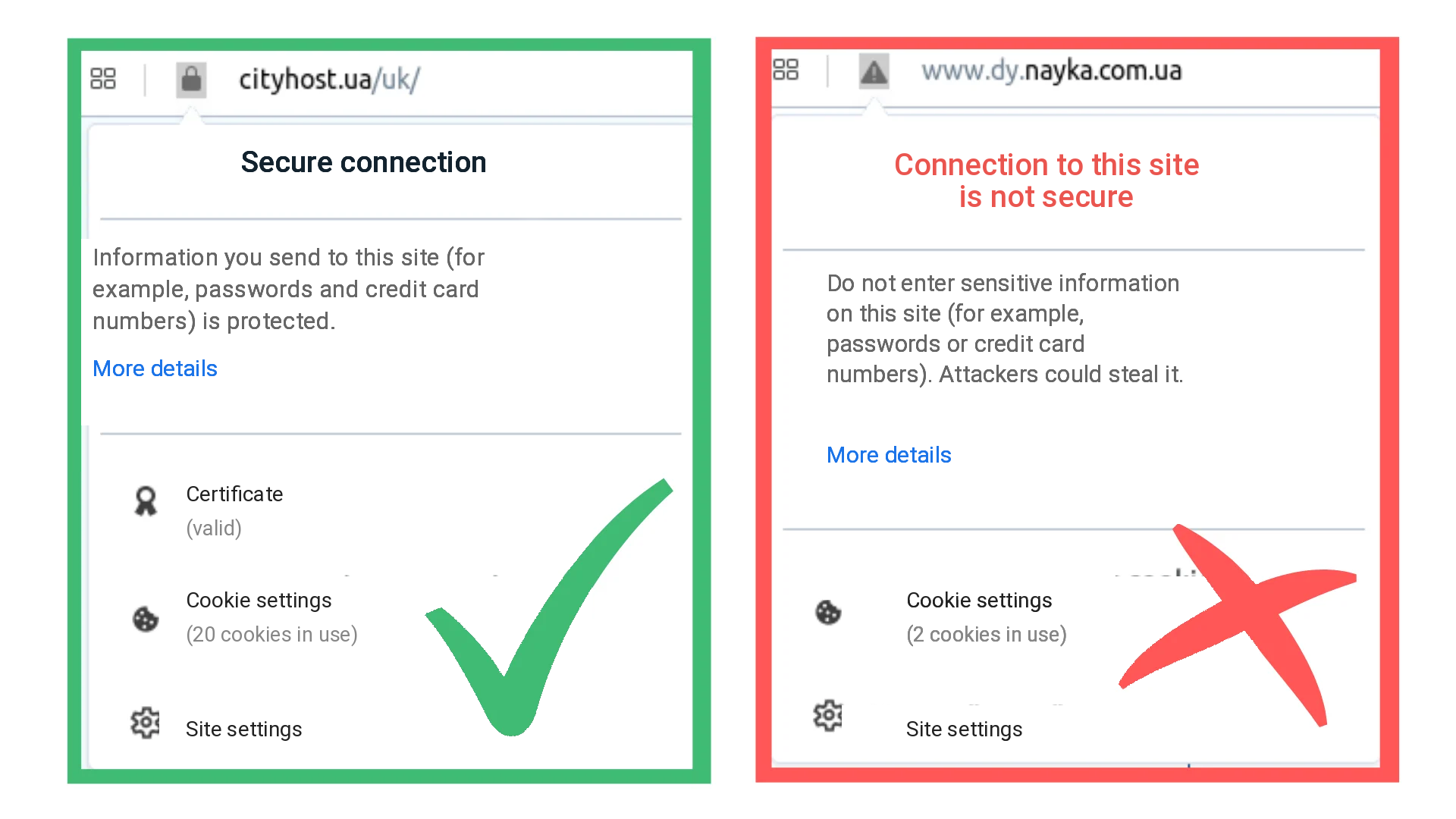

4. Teknik Kusurlar: SSL Sertifikası Eksikliği

Modern internet gerçeklerinde HTTPS protokolü bir avantaj değil, temel bir gerekliliktir.

Eğer Beyaz Sayfanız HTTP üzerinden çalışıyorsa ve temel bir SSL sertifikasına sahip değilse, bu durum reklam platformları ve tarayıcılar nezdinde otomatik olarak büyük şüphe uyandırır. Tarayıcı bu tür siteleri "Güvenli Değil" olarak işaretler, bu da moderasyon sırasında reklamların anında reddedilmesine yol açar. Ücretsiz bir sertifika (örneğin Let's Encrypt) yüklemek birkaç dakika sürer ancak reklam bütçenizi anlamsız kayıplardan kurtarır.

Eğer Beyaz Sayfanız HTTP üzerinden çalışıyorsa ve temel bir SSL sertifikasına sahip değilse, bu durum reklam platformları ve tarayıcılar nezdinde otomatik olarak büyük şüphe uyandırır. Tarayıcı bu tür siteleri "Güvenli Değil" olarak işaretler, bu da moderasyon sırasında reklamların anında reddedilmesine yol açar. Ücretsiz bir sertifika (örneğin Let's Encrypt) yüklemek birkaç dakika sürer ancak reklam bütçenizi anlamsız kayıplardan kurtarır.

Sonuç:

Cloaking'in reklam ağları tarafından açığa çıkarılması, trafik dağıtım sistemlerinin bir zayıflığından ziyade teknik eksikliklerin, aceleciliğin ve ayrıntılara dikkatsizliğin mantıksal bir sonucudur. Pratiğin gösterdiği gibi, Meta, Google veya Bing moderasyon algoritmaları kullanıcı yolculuğu mantığındaki en ufak tutarsızlıklara takılmaktadır. Gri dikey alanlarda başarılı ve uzun vadeli bir lansman, affiliate'in her teknik detayın kritik öneme sahip olduğu kapsamlı bir yaklaşım benimsemesini gerektirir.

Kurulum güvenliği, reklam platformu piksellerinin nihai Teklif Sayfasından veri almaması için analitiğin sıkı bir şekilde izole edilmesiyle başlar ve görsel, reklam ve Beyaz Sayfa arasındaki anlamsal alaka üzerine titiz bir çalışma ile devam eder. Kalıptaki herhangi bir kırılma veya doğal olmayan rota, eğitilebilir algoritmalarda anında şüphe uyandırır. Ayrıca, şüpheli yönlendirme zincirlerini en aza indirip doğrudan içerik yüklemeyi tercih etmek ve botları, VPN bağlantılarını, IPv6'yı ve yönlendireni olmayan geçişleri acımasızca kesen tavizsiz, çok seviyeli trafik filtrelemesi kurmak hayati önem taşır.

Bu güvenlik mimarisinin temeli her zaman Beyaz Sayfanın kendisidir. Sadece bir yer tutucu değil; teknik olarak kusursuz, yüksek yükleme hızına sahip, duyarlı tasarımlı, SSL sertifikasıyla korunan ve kesinlikle toksik geçmişi olmayan temiz bir alan adında barındırılan tam teşekküllü, benzersiz bir kaynak olmalıdır. Huninin tüm aşamalarında şeffaf ve yasal bir işletmenin kusursuz bir taklidi, botların ve manuel değerlendiricilerin ihtiyatını yatıştırabilir ve reklam kampanyalarınızın istikrarlı bir bütçe harcaması yapmasını ve erken engellemelerden korunmasını sağlayabilir.

Görüşünü paylaşan ilk kişi olun!

Geri bildiriminize değer veriyoruz — görüşünüzü paylaşın.